开源 ChatWiki:大模型 RAG + 工作流 + 公众号深度集成,一套系统打通客服与变现

传统运营一个公众号和微信生态私域,最大的问题就是:私信、评论、客服消息太多,靠人工根本忙不过来;知识库东一块、西一块,客服、销售、运营各查各的系统;想用大模型 + RAG 搭建智能客服,又要自己搭后端、配模型、做工作流,周期长、维护成本高。ChatWiki 这套开源系统,就是把「公众号 + 知识库 + 工作流 + 大模型」整合在一起,让每一个公众号都能快速升级成一个可赚钱的超级 AI Agent。

一、核心功能

- 1. 微信生态深度集成:从私信、评论到菜单点击全打通

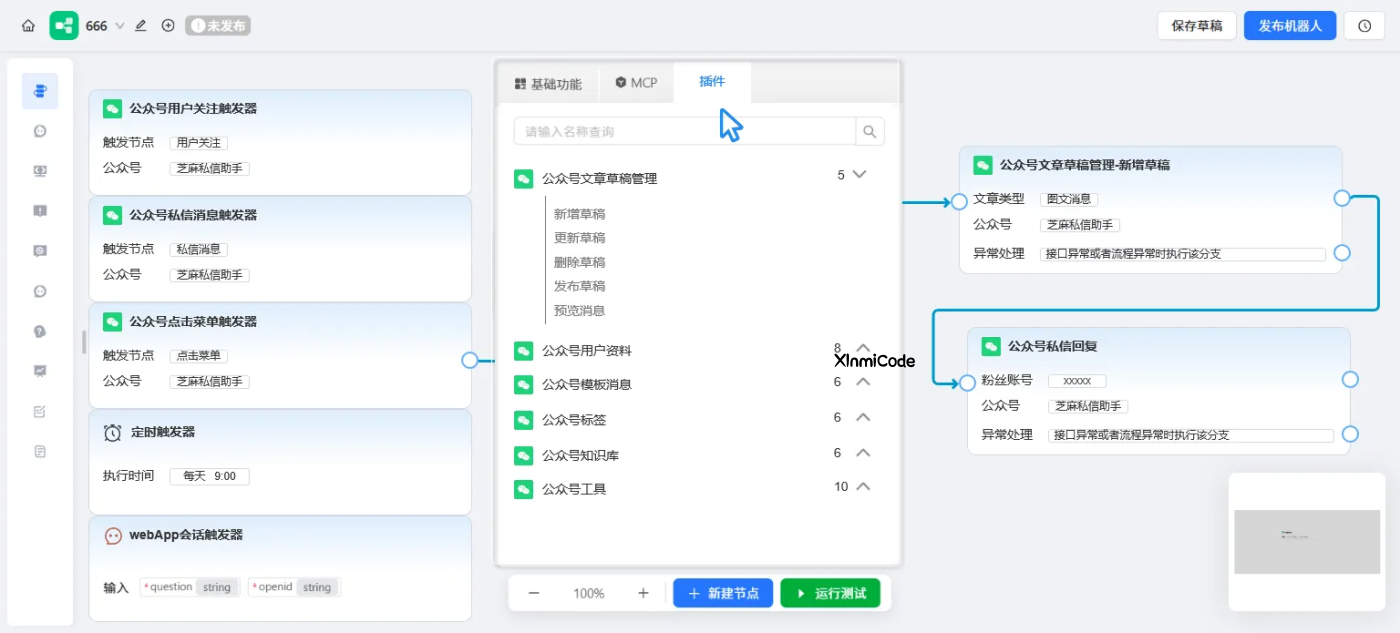

ChatWiki 针对微信生态做了深度适配,支持对未认证公众号的私信自动回复,覆盖文本、语音、图片、小程序卡片、视频消息等多种形态;同时把「关注 / 取关、评论、菜单点击」等触发事件全部纳入工作流里,开发者只需要拖拽配置,就能配置好欢迎语、打标签、发素材、推课程等自动化动作,让一个人就能运营原本需要一个小团队维护的私域矩阵。 - 2. 知识库 + RAG:公众号内容一键同步成可检索的知识图谱

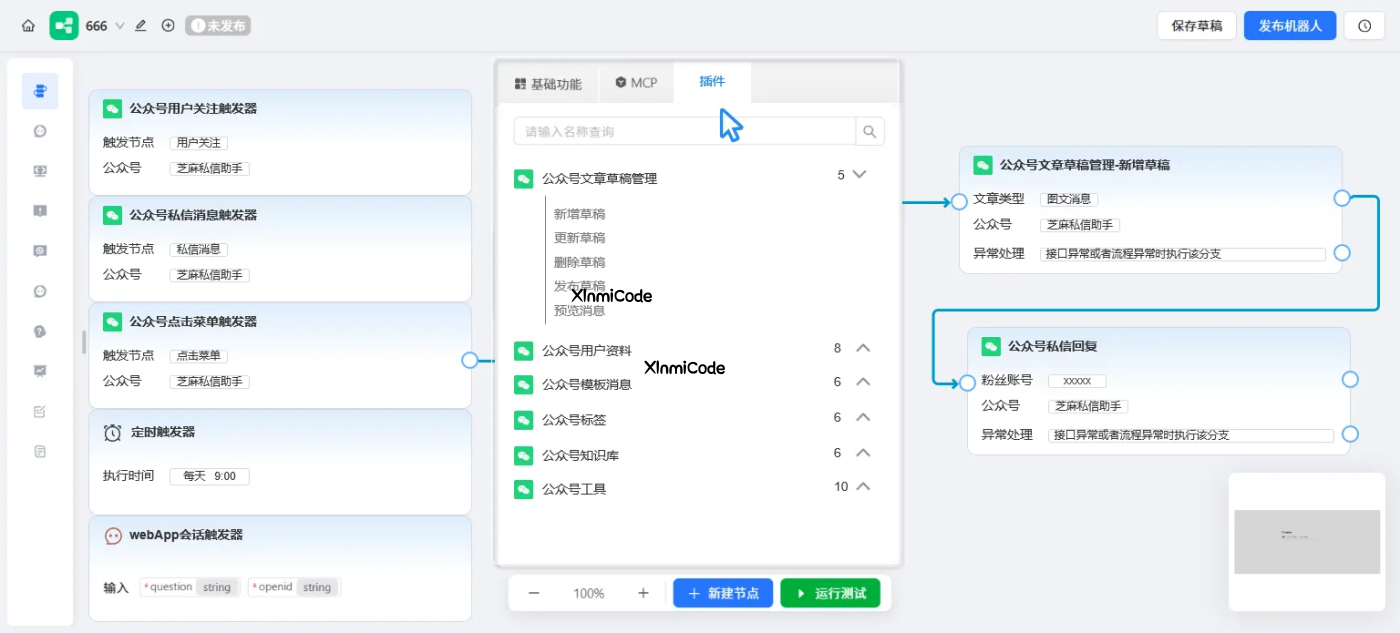

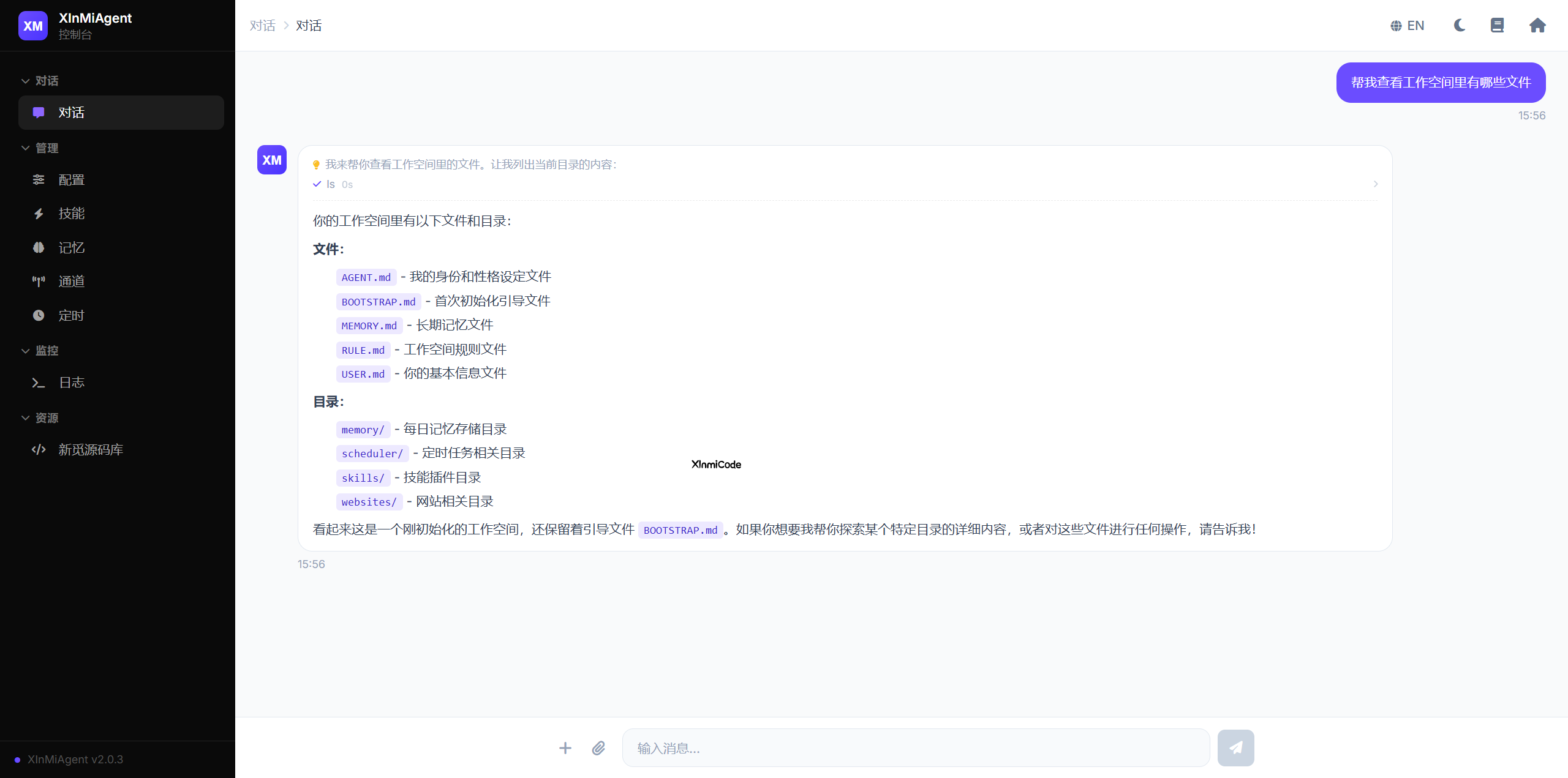

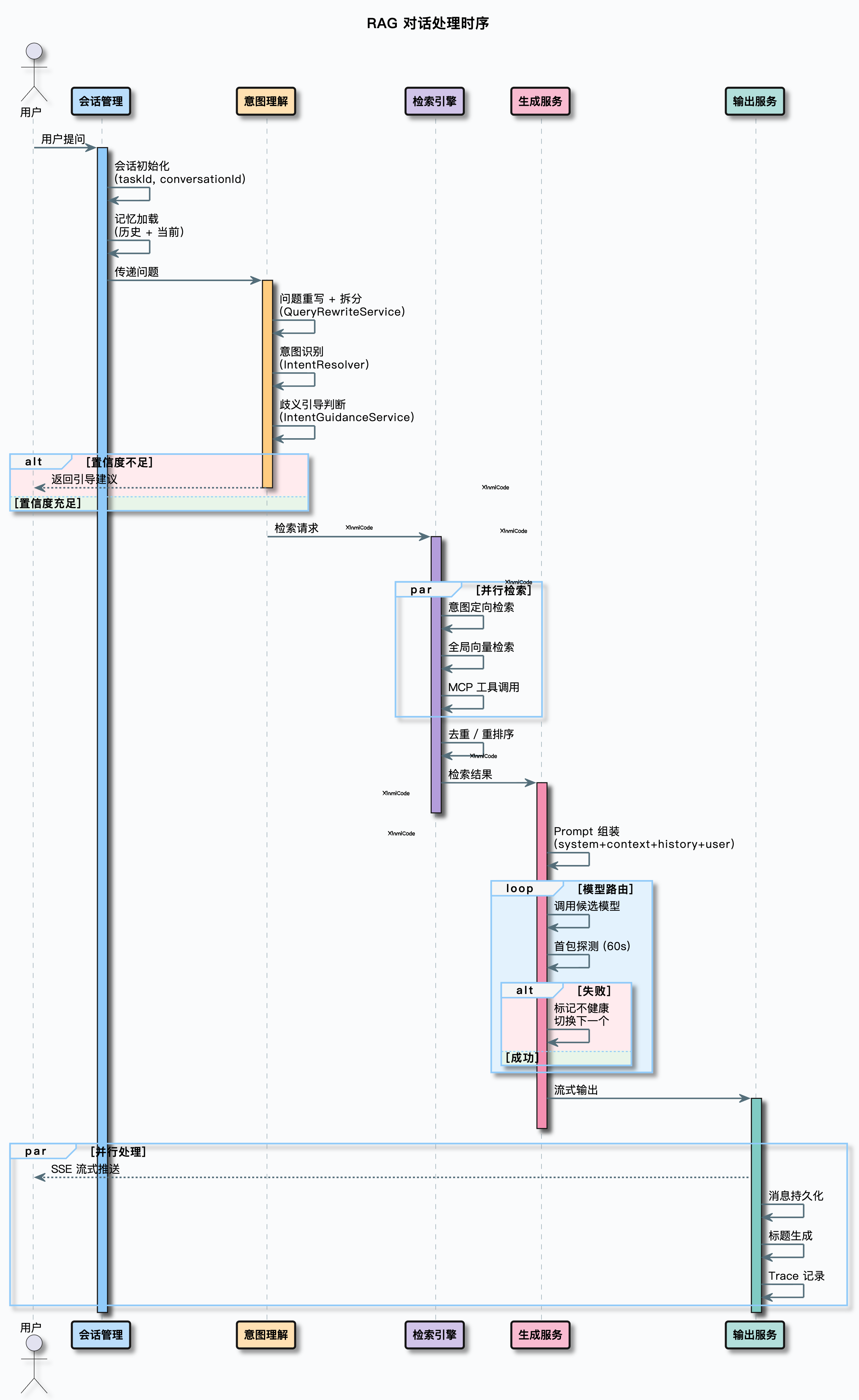

相比传统 FAQ 或零散文档,ChatWiki 支持把公众号文章、文档资料、网页链接等,一键抓取到知识库里,自动做 AI 分段、问答抽取、父子分段,并构建混合向量检索和知识图谱。这样不论是客服机器人还是内部同事,都可以通过自然语言在统一的知识空间里搜答案,减少「谁来更新文档」「哪个版本为准」这类反复内耗。 - 3. 工作流编排 + 插件化:从 AI 对话到业务系统打通

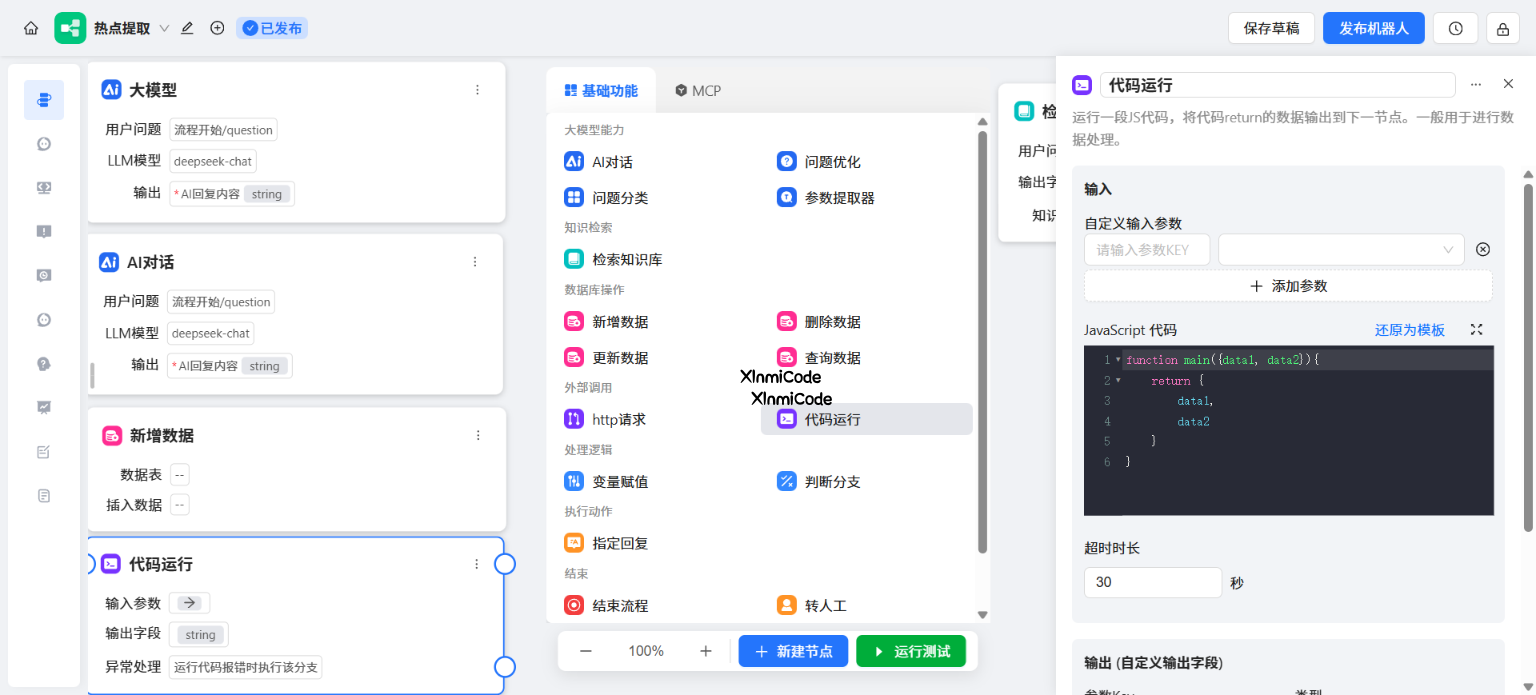

在 ChatWiki 中,AI 对话只是一个节点,开发者可以通过可视化工作流,把「MCP 双向调用」「插件调用」「第三方 API」「人工转接」等串联起来。比如:用户在公众号问价格 → 机器人用知识库回答 → 触发工作流给用户打上标签 → 调用外部 CRM API 创建线索 → 推课程或试用链接,全程无需手工介入,让 AI 服务真正进入业务闭环。

二、生活/工作帮助

- 1. 私域运营一人顶一队:从机械回复到智能响应

对于运营公众号和微信私域的团队,ChatWiki 可以把大量重复咨询交给机器人前置处理,人工只处理复杂或高价值场景。运营同学不必再 24 小时盯着私信和评论,可以把精力放在选题、活动设计和变现策略上,整体效率提升 60%–80%。 - 2. 知识统一、随用随查:告别文档到处飞

企业把产品手册、合同条款、培训资料等沉淀进知识库后,客服、销售、运营都能在同一个语义空间里搜答案,减少「这个文档在谁那儿」「最新版在哪儿」的沟通成本。新同事上手也能快速通过知识库自学,缩短培训周期。 - 3. 多通道统一入口:官网、公众号、小程序一个知识库

无论用户从官网咨询、公众号留言,还是在店铺小程序内提问,都能接入同一套 RAG 知识库与工作流。企业只需维护一套知识内容,多渠道自动同步,既省人力,又保证回答一致性。

三、怎么利用这个开源赚钱?

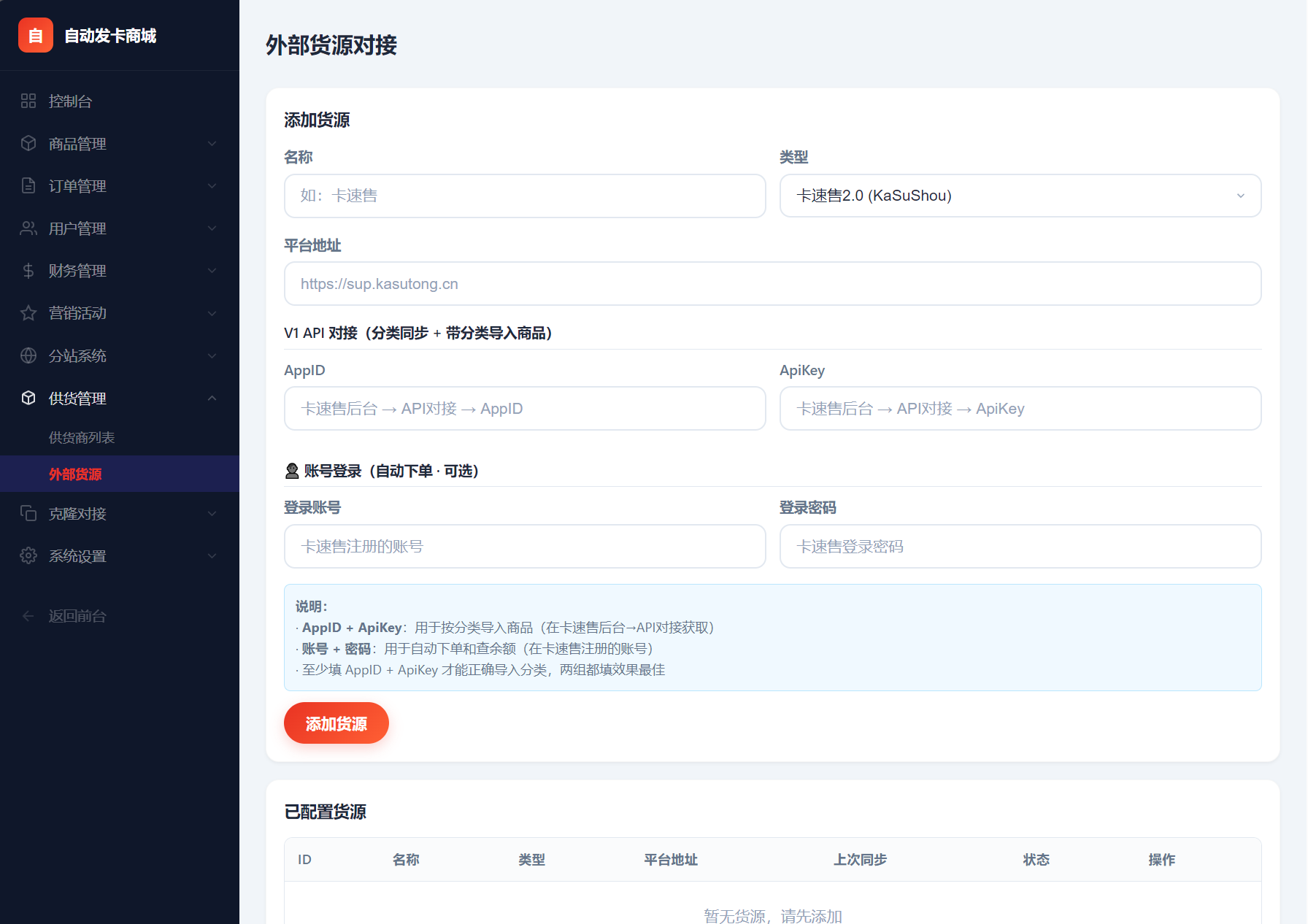

- 1. SaaS + 私有化部署:直接对外售卖解决方案

借助 ChatWiki 的开源特性和 Docker 一键部署能力,个人或小团队可以在自己的服务器上低成本跑起来,然后以「SaaS 订阅」或「私有化部署实施费」的方式对外售卖。客户看到的是品牌化的前端和稳定的 AI 服务,背后则是 ChatWiki 的工作流、知识库与多模型编排,极大缩短从 Demo 到可收费产品的距离。 - 2. 垂直行业方案:教育、企服、电商的 AI 顾问

对于教育培训、SaaS、toB 企服等需要大量知识沉淀的行业,ChatWiki 可以快速变成「招生顾问」「产品顾问」「法务助手」等专用 AI 角色。项目方把教材、手册、FAQ 沉淀进知识库后,按行业定制话术,直接承担一部分售前咨询和客户教育,实现按对话量或按项目收费。 - 3. 二次开发与培训服务

技术团队可以基于 ChatWiki 做定制开发,对接客户既有 CRM、ERP 等系统,收取实施费和后续维护费;同时,针对「如何用 ChatWiki 搭建 AI 客服」「如何做知识库运营」等主题开设培训课程,拓展咨询与培训收入。

四、AI 时代新功能

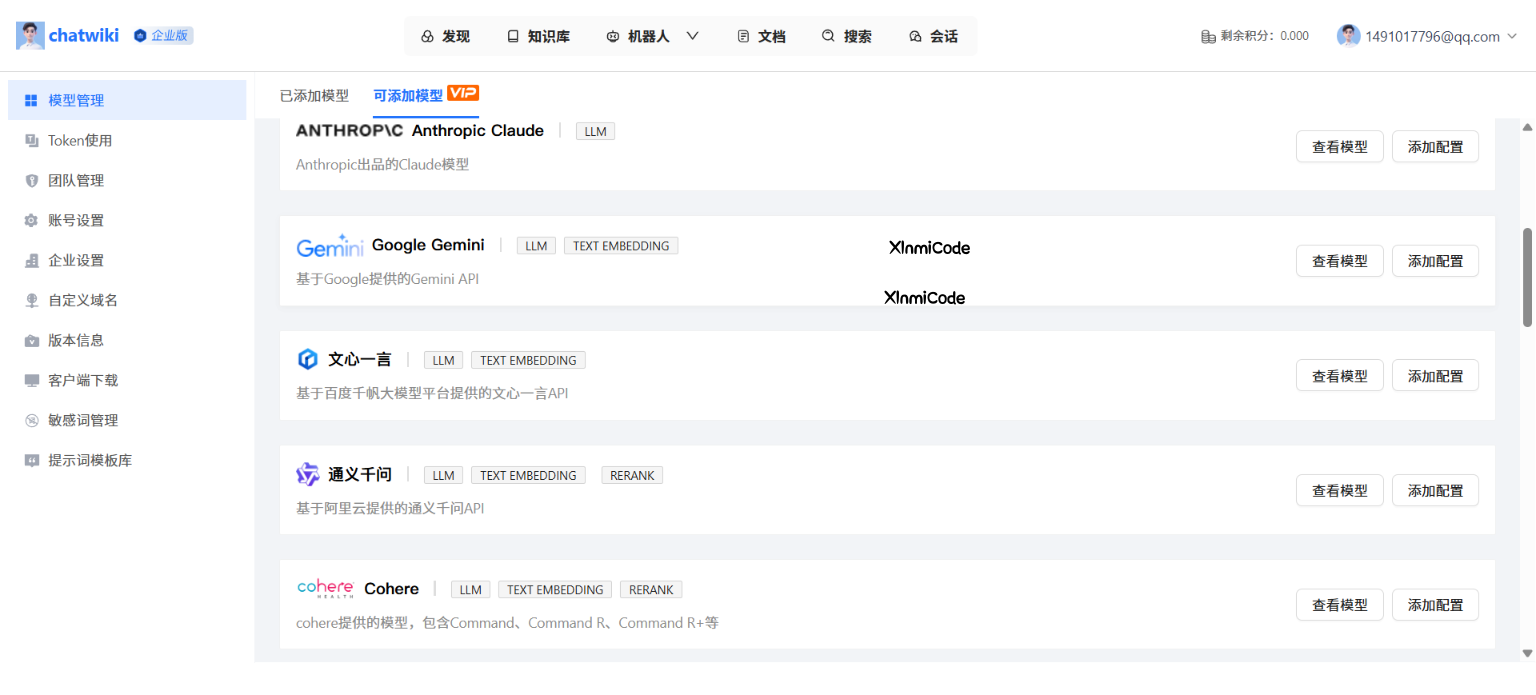

- 1. 多模型切换与混合编排:按场景选择最优模型

ChatWiki 原生支持二十多种主流模型,包括 DeepSeek R1、doubao pro、qwen max、OpenAI、Claude 等,后续还在持续增加 OpenRouter、302.AI 等聚合渠道。不同场景可以选择不同模型,例如:解释代码用一个,改写文案用一个,RAG 检索再配一个,既能控制成本,又能保证效果。 - 2. 更智能的知识库构建与自动学习

系统支持批量导入文档、自动分段、自动抽取问答,对未知问题做聚类,帮助运营者快速发现「大家最近都在问什么」。配合工作流里的自动学习能力,新导入的文档会自动进入学习流程,形成新的问答库,避免「文档更新了但机器人还在说旧答案」的尴尬。 - 3. Agent 与 MCP 生态:工作流即 AI 应用

通过双向 MCP、插件工作流和用户交互节点,ChatWiki 可以把复杂的业务逻辑拆解为多节点编排,支持 Agent 模式。开发者可以把工作流发布为 MCP 服务供外部调用,或引入外部 MCP 扩展能力,形成可组合的 AI 应用生态。

五、接下来可以往哪个方面优化

- 1. 工作流可视化与低代码体验

进一步优化拖拽式编排的交互体验,增加更多预设模板和常用节点,降低非技术用户的学习成本;支持工作流版本管理、灰度发布等企业级能力。 - 2. 知识库冷启动与智能推荐

针对新接入的公众号或文档较少的场景,提供「相似公众号推荐」「行业模板知识库」等冷启动能力;在对话中智能推荐相关文档或 FAQ,提升首次回答准确率。 - 3. 多租户与计费能力

对于 SaaS 形态,可增加多租户隔离、按对话量 / 按知识库容量计费等能力,方便服务商按需收费;同时完善权限体系,支持更细粒度的数据权限控制。

六、自动化 AI 部署

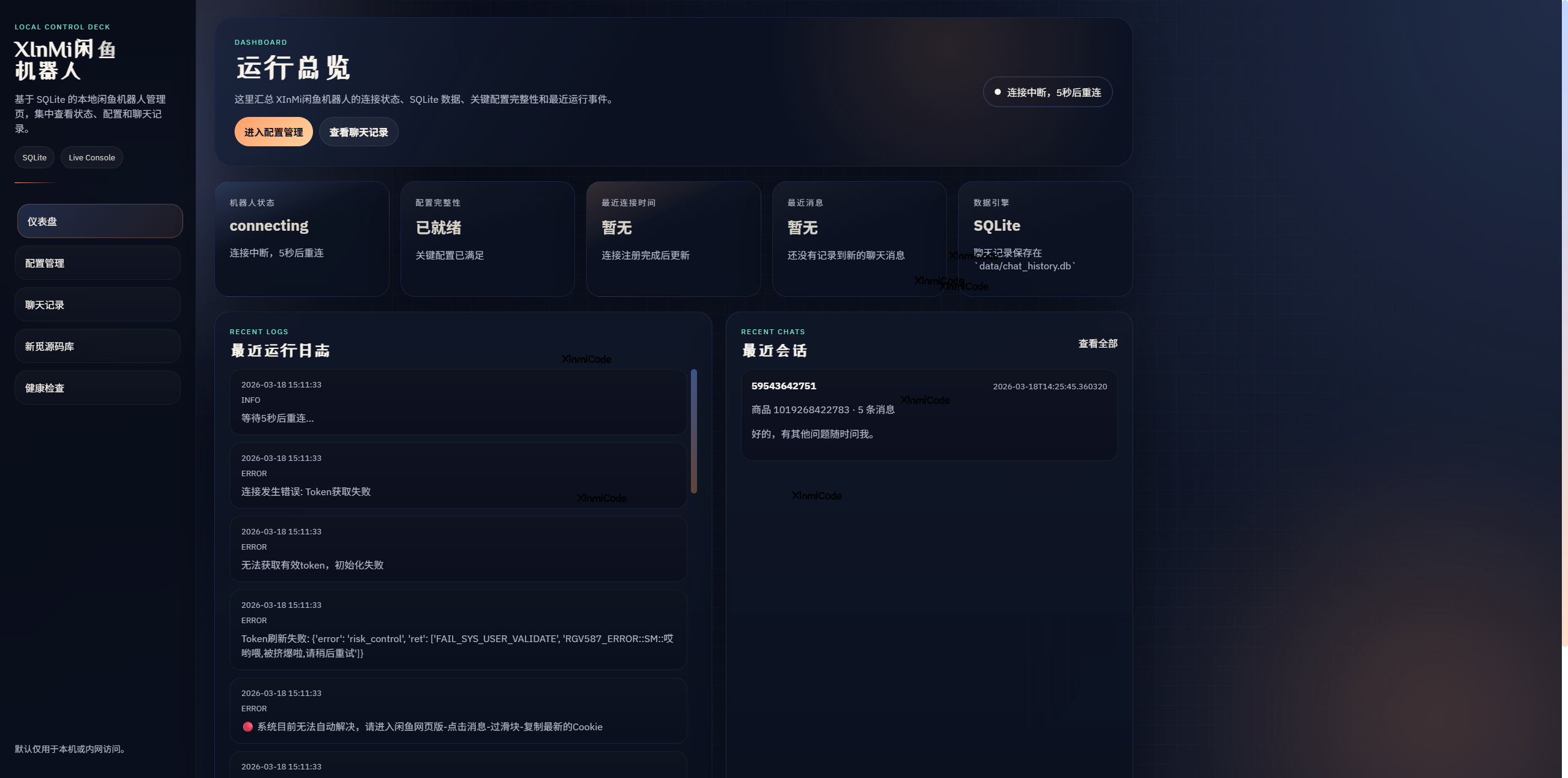

- 1. Docker 一键起盘:几条命令完成部署

ChatWiki 社区版提供清晰的一键部署方案:安装 Docker、拉取源码、进入chatwiki/docker目录、执行docker compose up -d即可启动服务,默认端口可配置,支持多环境部署,无需复杂运维经验。 - 2. 官方安装助手与多种部署方式

官方提供 ChatWiki 安装助手,以及宝塔面板、1Panel、免 Docker 部署等多种方案文档,适合不同技术背景的用户;未来可配合 CI/CD,把版本升级、配置同步自动化。 - 3. AI 辅助配置:模型接入与域名配置

系统支持接入 OpenRouter、302.AI 等聚合渠道,模型管理页面可配置 API 域名和 Key;配合官方文档中的「如何获取大模型 ApiKey」「如何配置对外服务和接收推送的域名」等指引,开发者可快速完成从部署到上线的全流程。

七、未来发展

- 1. 社区生态与商业化双轮驱动

ChatWiki 采用 ChatWiki Open Source License,对个人用户免费,企业商业使用需获取授权。社区持续迭代功能,如多模态内容、国外注册、公众号文章手动/自动同步等,商业版则提供更完善的企业级能力与技术支持。 - 2. 能力边界拓展:更多平台与更多模型

除公众号外,已支持 WebApp、嵌入网站、服务号、微信客服、微信小店客服等多种形态;模型支持持续扩充,自有模型可接入通义千问/万像图像等,满足多模态场景需求。 - 3. 知识库与工作流深度耦合

知识库召回支持元数据筛选与变量引用,工作流节点支持代码执行(Python)、钉钉多维表等插件,机器人统计分析支持按渠道分类,未来会进一步强化「知识 + 工作流 + 对话」的闭环能力。

总结

总体来看,ChatWiki 把「公众号 + 微信生态 + 知识库 + 工作流 + 大模型」这一整套能力打包成了一个可落地的开源产品,让个人和团队都能用更低的成本搭建出专业的 AI 客服与知识库系统,既能提升内部效率,又能直接对外售卖方案、实现商业化。

如果你正在为私域运营、人手紧缺、知识库混乱或者 AI 项目落地困难发愁,不妨试试这套开源的 ChatWiki 系统,让公众号真正成为你的超级 AI 合伙人。用过类似项目的朋友,欢迎在评论区分享你的使用心得;觉得有收获的话,别忘了点赞、在看、分享给更多开发者~

—— 小新

图片

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容